FBI cảnh báo về nạn tống tiền bằng công nghệ deepfake

FBI (Cục điều tra liên ban Mỹ) cho biết ngày càng có nhiều khiếu nại về vấn đề lừa đảo bằng cách deepfake để làm ra các video khiêu dâm giả mạo người khác. Kẻ xấu sẽ tống tiền người bị hại với một khoảng tiền lớn, nếu không sẽ công khai đoạn video trên.

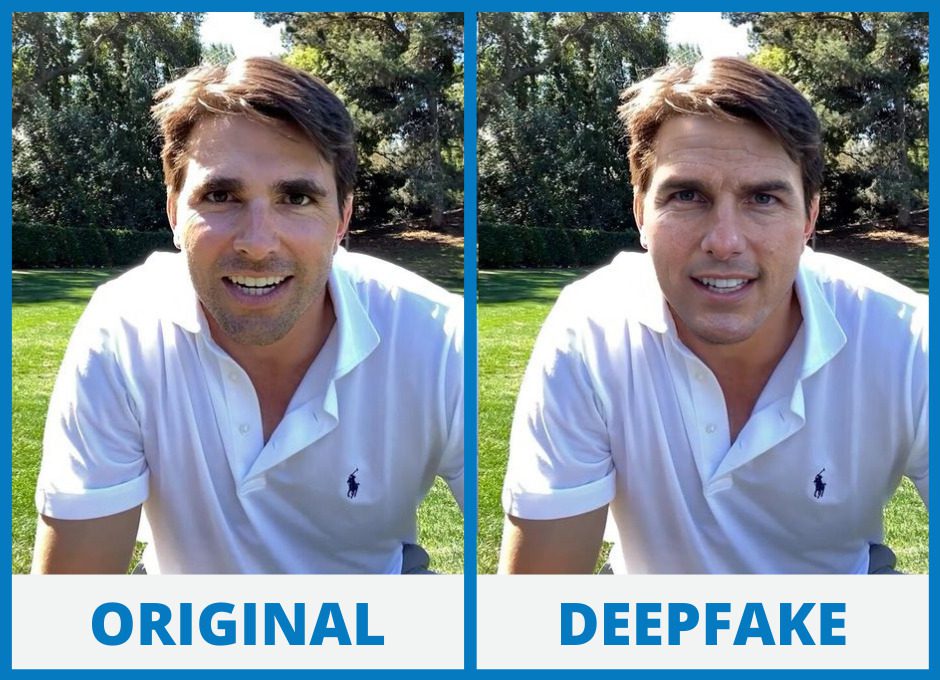

Deepfake là một cụm từ được kết hợp từ “deep learning” và “fake”. Đây là phương thức tạo ra các sản phẩm giả (fake) dưới dạng âm thanh, hình ảnh hoặc thậm chí là cả video, bởi trí tuệ nhân tạo (AI) tinh vi. Công nghệ này sẽ quét video và hình ảnh để ghép những chi tiết trên gương mặt như mắt, mũi, miệng vào hình ảnh gốc. Từ đó tạo ra những video chuyển động, nói chuyện như thật.

Chỉ cần có nhiều hình ảnh gốc của một người thì các hình ảnh deepfake càng chân thật. Lợi dụng điều này, các kẻ lừa đảo lợi dụng những hình ảnh và đoạn video từ tài khoản mạng xã hội của nạn nhân để tạo ra những video deepfake. Các kẻ lừa đảo thường tống tiền nạn nhân, trong đó có cả trẻ em, trả bằng tiền mặt, thẻ quà tặng hoặc thậm chí là hình ảnh nhạy cảm của họ, kèm lời đe doạ sẽ đe dọa công khai những video deepfake lên internet hoặc gửi cho bạn bè và gia đình nếu nạn nhân không làm theo.

Thực chất, “vấn nạn” deepfake đã xuất hiện năm 2017 với hàng loạt video khiêu dâm mạo danh người nổi tiếng, như diễn viên Gal Gadot, Emma Watson, Scarlett Johansson hay Daisy Ridley. Nhưng với sự phát triển của công nghệ, việc làm ra các video deepfake lại trở nên dễ dàng hơn rất nhiều. Lợi dụng điều này, kẻ xấu đã chuyển đối tượng tống tiền qua những người bình thường, không nổi tiếng.

FBI cảnh báo người dùng internet nên cẩn thận khi chấp nhận lời mời kết bạn từ người lạ. Người dùng cũng nên nhớ rằng dù bạn có trả tiền theo yêu cầu của kẻ lừa đảo hay không, cũng không tránh được việc video deepfake bị phát tán ra ngoài. Tại Mỹ, tổ chức Take It Down đã được ra đời nhằm giúp ngăn chặn việc chia sẻ hình ảnh không được cho phép của trẻ dưới tuổi vị thành niên. Sensity AI – một công ty chuyên nghiên cứu về trí tuệ nhân tạo và cung cấp giải pháp nhận dạng deepfake – đã thông báo rằng phụ nữ chính là nạn nhân của công nghệ này khi có hơn 90% nội dung deepfake liên quan đến khiêu dâm tấn công vào người dùng nữ.